基于INTEL 11代芯片Tiger Lake 在AI 套件OPENVINO上所開發之智合科技車聯網暨駕駛行為解決方案

隨著 5G 及車聯網發展,物流業主需要更具智慧的管理物流駕駛的系統,現行市場中仍處于安裝行車記錄器來進行事后究責,無法達到事前預警及駕駛行為有效的改善。本提案透過兩支攝影機(車前影像及駕駛畫面)進行在線影像分析,使用高效AI運算主機(HPC)分析車前狀況及駕駛行為,當發生異常事件后,進行即時告警,并進行事件錄影,透過4G/5G網路提供管理者查閱,讓管理者隨時檢視行車狀態(例如跟車過近或行人追撞危險),即時發現并修正駕駛行為異常(例如分心)。

其用途為:

· 保障駕駛安全

· 透過駕駛行為智能分析來修正駕駛行為,以保護用路人安全

解決方案

本系統特別適合應用于 運輸業 的駕駛管理,我們使用:

· Intel 11 代 TigerLake Edge Computer 及 NCS2 神經棒來提供高效能的 AI 運算

· 使用二支 Webcam 擷取車前及駕駛影像,其中車前影像進行人車物件偵測及追蹤,稱為 ADAS;車內影像進行駕駛人臉識別 [5]及頭部姿態角追蹤 [2],稱為 DMS

· 當系統偵測到 駕駛行為異常時,會即時提出警示,并進行后端錄影

· 車隊管理者可以透過 4G/5G 路由連入檢測駕駛行為 異常狀況,可做駕駛行為評分依據。

在開發過程中所用軟硬體如下:

硬體:

軟體:

1.系統架構-開發硬體平臺:Intel 11 代 TigerLake Edge Computer+ Intel? NCS2 + Webcam x2 + 路由器

本系統由兩支Webcam擷取車前及駕駛座影像,至車聯網AI平臺并將影像分流至OpenVINO平臺進行AI inference,并將異常事件上傳至駕駛監控平臺,業主能透過駕駛監控平臺得知目前駕駛狀態。(圖一所示)

圖一 系統架構

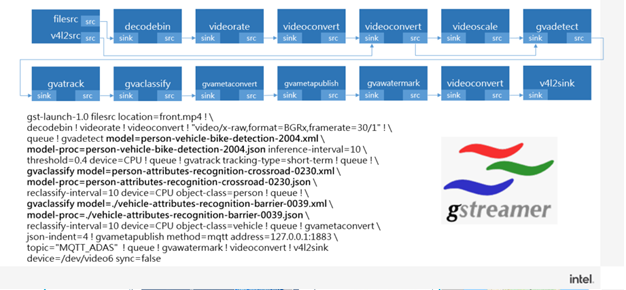

2.技術架構-OpenVINO GStreamer [4]

在串流處理,我們采用 OpenVINO 平臺搭配 GStreamer 及 OpenCV 方式進行。

AI 順向使用 OpenVINO 預訓練模型 [1],主要有三類:

· 車前物件偵測及屬性識別

· 人臉檢測及頭部姿態角追蹤

· 人臉識別

影像輸入,可透過 Web Camera 或 檔案方式輸入,Inference 后的影像輸出到二路 V4L2 裝置 [3]

使用 GStreamer 連接 ADAS 及 DMS 所需的預訓練模型(由OpenVINO提供),將 Inference 后的結果,由 MQTT 傳至團隊開發的 AI 智能駕駛行為分析程式進行分析,使用 OpenCV 進行 online 貼圖,并將駕使行為異常結果儲存于資料庫,管理者可透過 本團隊開發之駕駛監控平臺進行異常事件的檢索。(圖二所示)

圖二 技術架構圖

3.ADAS Pipeline

圖三為 GStreamer 連接 OpenVINO Model(人、車、自行車辨識)、(人物屬性辨識)、(車輛屬性辨識)之 ADAS Pipeline:

圖三 ADAS Pipeline

DMS Pipeline

圖四為 GStreamer 連接 OpenVINO Model(頭部姿態角辨識)、(人臉辨識)之DMS Pipeline:

圖四 DMS Pipeline

成果介紹短片

成果介紹

· 安裝模擬場景

圖五 模擬場景

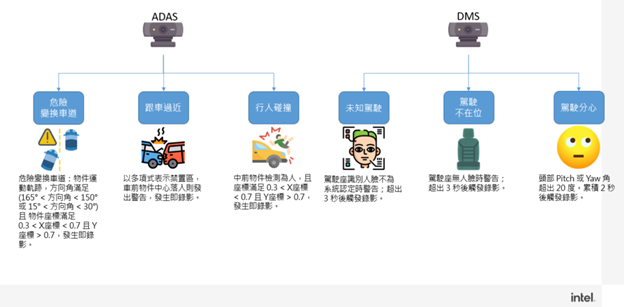

· ADAS 與 DMS 功能介紹及觸發條件

圖六 功能介紹

· 車機畫面及駕駛監控平臺 – 展示說明

圖七 車機畫面介紹

圖八 駕駛監控平臺操作步驟

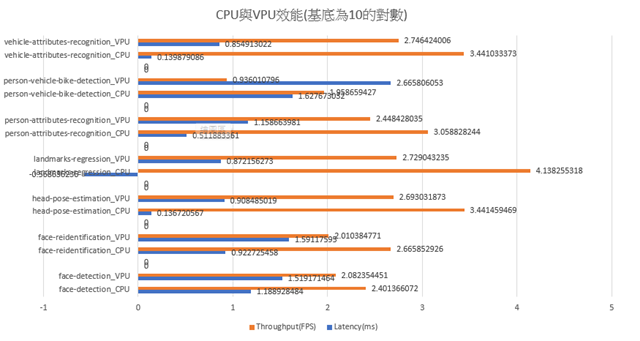

· 各項Model使用CPU及VPU效能表現

圖九 Model使用CPU及VPU效能

圖十 使用 CPU 及VPU 效能圖表 (因值域差異大,以 Log10 對數表示)

圖十一 裝置工作詳細內容

以下概略說明主要硬體的使用方式及整合后系統效能的表現,其中CPU 占比最高,功能包含:

· 負責兩項 AI 功能:車前物件偵測與追蹤,及駕駛頭部姿態角

· 應用端的邏輯及 online OSD 貼圖

· 網頁服務器及資料庫

GPU 提供車機影像的顯示,NCS2 神經棒負責第三個AI的功能:人臉偵測與識別。

輸入資料量為兩只 Web Camera 攝影機,其分辨率為 752×416@30 FPS,整合后的系統效能,張數大約落在 15~25 張。

本系統能即時分析輔助駕駛并讓業主了解駕駛行為表現,可以進行員工教育,提升駕駛素質,保障駕駛及用路人的生命安全。

評論