有研究表明:使用AI會對專業聲譽產生負面影響

根據杜克大學的一項新研究,使用人工智能可能是一把雙刃劍。雖然生成式人工智能工具可能會提高某些人的工作效率,但它們也可能會在不知不覺中損害你的職業聲譽。

本文引用地址:http://www.104case.com/article/202505/470243.htm周四,《美國國家科學院院刊》(PNAS)發表了一項研究,顯示在工作中使用像ChatGPT、Claude和Gemini這樣的人工智能工具的員工會受到同事和經理對其能力和動機的負面評價。

杜克大學富卡商學院的研究人員杰西卡·A·賴夫(Jessica A. Reif)、理查德·P·拉里克(Richard P. Larrick)和杰克·B·索爾(Jack B. Soll)在論文中寫道:“我們的研究結果揭示了人們在考慮采用人工智能工具時面臨的一個困境:盡管人工智能可以提高生產力,但其使用會帶來社交成本。”

杜克團隊進行了四項實驗,共有4400多名參與者,以研究對人工智能工具用戶的預期和實際評價。他們的研究結果發表在題為“使用人工智能的社交評價懲罰的證據”的論文中,揭示了對那些從人工智能中獲得幫助的人存在一致的偏見。

研究人員發現,這種懲罰尤其令人擔憂的是其在不同人群中的普遍性。他們發現,對人工智能使用的社交污名并不局限于特定群體。

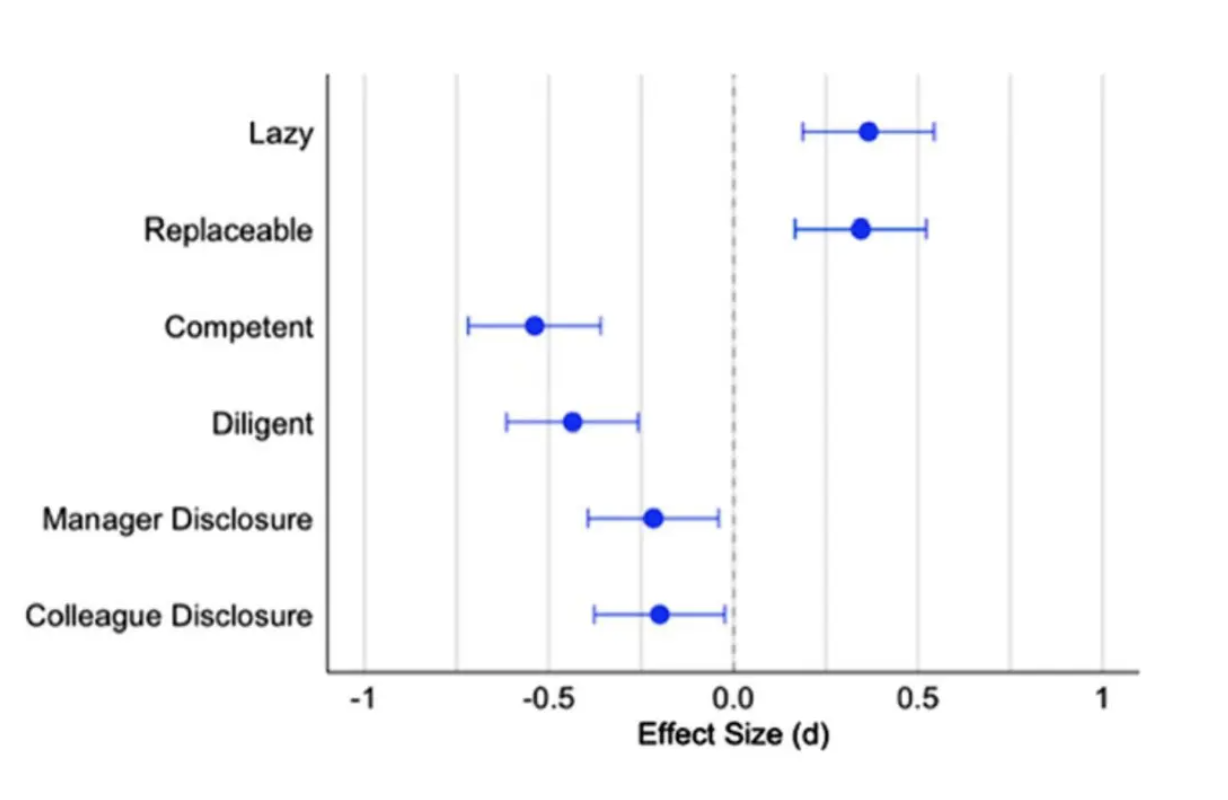

圖1. 預期感知差異和向他人披露的效果大小(研究1)。注:正的d值表示人工智能工具條件下的值更高,負的d值表示人工智能工具條件下的值更低。N=497。誤差條代表95%置信區間。變量之間的相關性范圍為|r|=0.53至0.88。 圖1來自論文“使用人工智能的社交評價懲罰的證據”。

“測試廣泛范圍的刺激使我們能夠檢驗目標的年齡、性別或職業是否會影響從人工智能中獲得幫助對這些評價的影響,”作者在論文中寫道,“我們發現,這些目標人群的人口統計學屬性并不影響從人工智能獲得幫助對懶惰、勤奮、能力、獨立或自信的感知的影響。這表明,對人工智能使用的社交污名化并不局限于特定人群的使用。結果似乎是一個普遍現象。”

人工智能采用的隱藏社交成本

在杜克團隊進行的第一項實驗中,參與者想象在工作中使用人工智能工具或儀表盤創建工具。結果顯示,人工智能組的人預計會被認為比使用傳統技術的人更懶惰、能力更差、不那么勤奮、更容易被取代。他們還報告說,他們不太愿意向同事和經理透露自己使用人工智能的情況。

第二項實驗證實了這些擔憂是合理的。在對員工的描述進行評估時,參與者一致認為那些從人工智能中獲得幫助的人比從非人工智能來源獲得類似幫助或根本沒有獲得幫助的人更懶惰、能力更差、不那么勤奮、不那么獨立且缺乏自信。

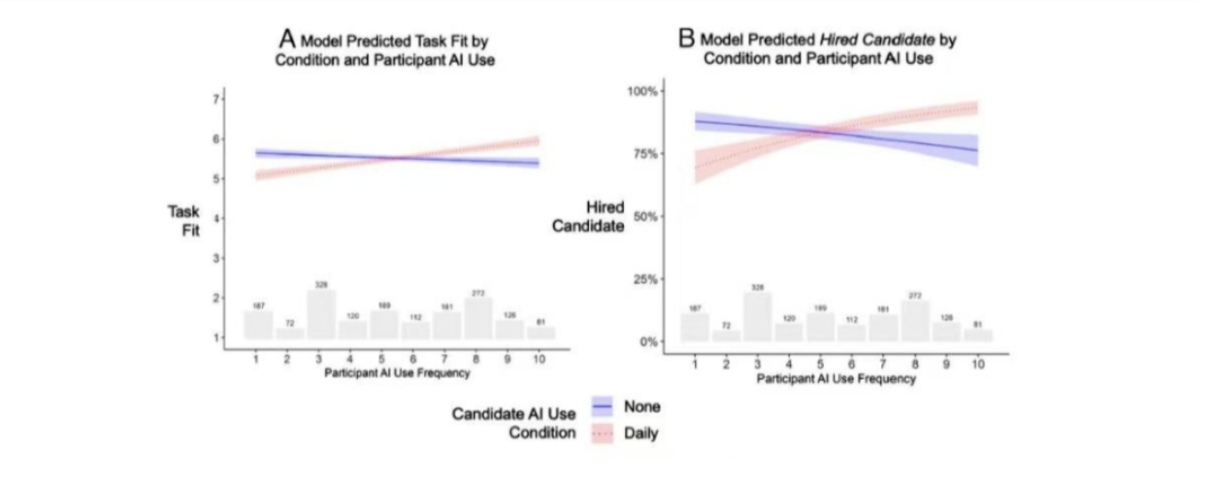

圖2 論文《使用人工智能的社交評價懲罰的證據》

研究人員發現,這種偏見會影響真實的商業決策。在一項招聘模擬實驗中,那些自己不使用人工智能的經理更不愿意招聘經常使用人工智能工具的候選人。然而,經常使用人工智能的經理則表現出相反的偏好,更傾向于選擇使用人工智能的候選人。

最后一項實驗揭示了“懶惰”的感知直接解釋了這種評價懲罰。研究人員發現,當人工智能對分配的任務明顯有用時,這種懲罰可以被抵消。當使用人工智能對工作有意義時,負面的感知會顯著減少。

值得注意的是,研究表明,評估者自己對人工智能的使用經驗顯著影響了他們的判斷。在研究中,那些頻繁使用人工智能的人不太可能認為使用人工智能的候選人是懶惰的。

復雜的情況

杜克大學的人工智能研究還指出,歷史上其他新技術也曾引發類似的污名化擔憂。從柏拉圖質疑寫作是否會削弱智慧,到現代關于教育中使用計算器的辯論,人們長期以來一直擔心節省勞動力的工具可能會反映使用者能力不足。

賴夫及其同事建議,這種社會影響可能成為工作場所采用人工智能的隱藏障礙。即使組織推動人工智能的實施,個別員工可能會因為擔心自己會被如何看待而抵制。

這種困境似乎已經出現。去年8月,在報道ChatGPT活躍周用戶數達到2億時,我們提到沃頓商學院教授埃森·莫利克(他經常研究人工智能)稱那些使用人工智能卻不告訴老板的人為“秘密賽博格”。由于許多公司禁止使用人工智能輸出,許多員工據稱轉向了秘密使用人工智能。

如果這還不夠復雜的話,我們之前報道的另一項研究為人工智能工作場所問題增加了不同的層面。芝加哥大學和哥本哈根大學的經濟學家發現,盡管64%到90%的員工報告稱人工智能工具節省了時間,但這些好處有時會被技術創造的新任務所抵消。研究顯示,人工智能工具實際上為8.4%的員工創造了額外的工作,包括那些負責檢查人工智能輸出質量或檢測學生作業中人工智能使用情況的非用戶。

因此,盡管使用人工智能完成某些任務可能節省時間,但員工可能會為自己或他人創造額外的工作。事實上,世界經濟論壇的《2025年就業前景報告》指出,人工智能可能會在全球范圍內創造1.7億個新職位,同時消除9200萬個職位,到2030年凈增加7800萬個職位。所以,情況雖然復雜,但人工智能對工作的影響正在以穩定的步伐持續進行。

評論