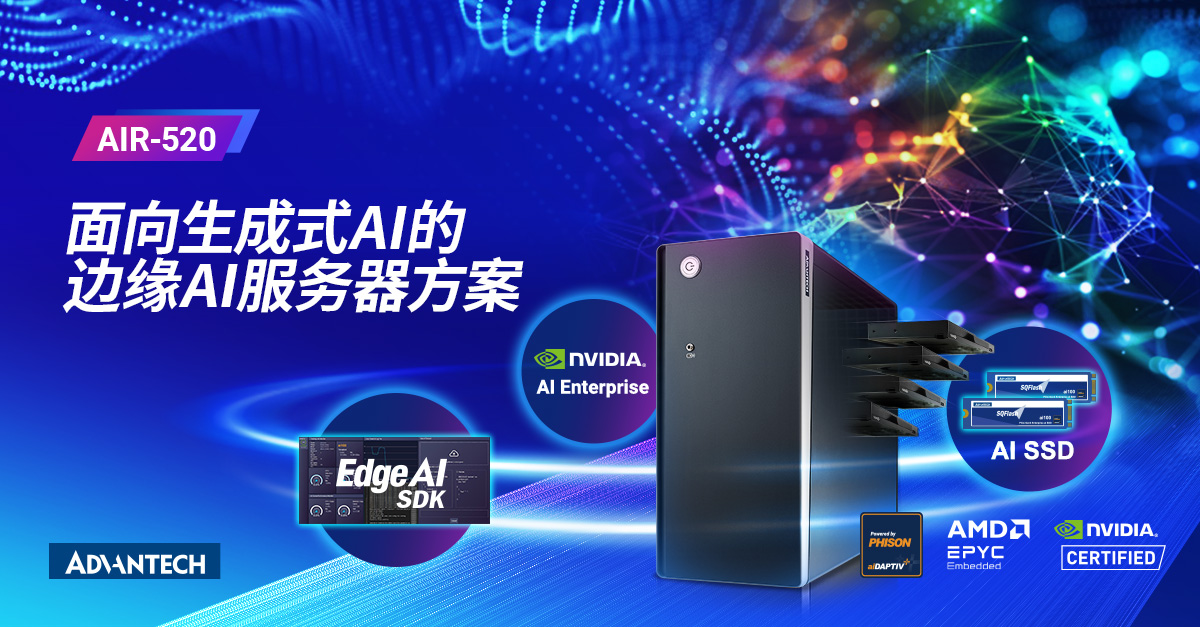

研華推出面向生成式AI的邊緣AI服務(wù)器解決方案

全球工業(yè)物聯(lián)網(wǎng)廠商研華科技宣布,采用Phison的aiDAPTIV+專利技術(shù),為生成式人工智能(Generative AI)提供開(kāi)創(chuàng)性的邊緣AI服務(wù)器解決方案。AIR-520 Edge AI Server采用AMD EPYC 7003系列處理器,集成了SQ ai100 AI SSD、NVIDIA RTX GPU卡、Edge AI SDK和NVIDIA AI Enterprise,提供了一個(gè)可立即部署的解決方案。

本文引用地址:http://www.104case.com/article/202407/461076.htm大型語(yǔ)言模型(LLM)等生成式AI工具正通過(guò)自動(dòng)化數(shù)據(jù)組織、檢索和分析改變企業(yè)知識(shí)管理,提高生產(chǎn)力并改善決策。定制大型語(yǔ)言模型(LLM)提高了準(zhǔn)確性,而邊緣訓(xùn)練則增強(qiáng)了數(shù)據(jù)隱私屬性(成本相應(yīng)提高)。該方案支持大型語(yǔ)言模型(LLM)微調(diào)配備1-4個(gè)顯卡和SQ AI100 AI SSD,供企業(yè)經(jīng)濟(jì)高效地訓(xùn)練大型語(yǔ)言模型(LLM),同時(shí)保護(hù)邊緣敏感數(shù)據(jù)安全。

適用于不同應(yīng)用的四種解決方案

對(duì)此研華提供四種選擇:AIR-520-L13B/L33B/L70B和L70B-Plus,針對(duì)不同規(guī)模和應(yīng)用量身定制。L13B非常適合聊天機(jī)器人和語(yǔ)言翻譯提高生產(chǎn)力和內(nèi)容創(chuàng)作創(chuàng)新能力。L70B擅長(zhǎng)專業(yè)領(lǐng)域的復(fù)雜數(shù)據(jù)分析和決策。此外,L70B-Plus配備了NVIDIA AI Enterprise軟件平臺(tái),提供端到端的、可靠的優(yōu)化AI SDK,提供長(zhǎng)期支持和專家咨詢服務(wù),保障業(yè)務(wù)場(chǎng)景中的高效部署。

安裝簡(jiǎn)單快捷,優(yōu)化成本效益

所有解決方案均包含SQ AI100 AI SSD,后者采用群聯(lián)(Phison)aiDAPTIV+技術(shù)。此系列SSD充當(dāng)顯卡vRAM的擴(kuò)展,使系統(tǒng)能夠使用最少的顯卡對(duì)大型語(yǔ)言模型(LLM)實(shí)現(xiàn)微調(diào)。這種方案不僅減輕了客戶的預(yù)算負(fù)擔(dān),而且相比傳統(tǒng)的大型機(jī)架式服務(wù)器,邊緣AI服務(wù)器會(huì)更加緊湊。AIR-520邊緣AI服務(wù)器專為各種邊緣AI應(yīng)用設(shè)計(jì),尺寸與臺(tái)式電腦相當(dāng),并且可以通過(guò)適當(dāng)?shù)母郊惭b在機(jī)架上。憑借輕薄的設(shè)計(jì),該產(chǎn)品可以實(shí)現(xiàn)在邊緣AI微調(diào)環(huán)境中的輕松部署,打消了客戶在空間和維護(hù)上的憂慮。

通過(guò)軟件服務(wù)快速跟蹤生成式AI的開(kāi)發(fā)

除了大型語(yǔ)言模型(LLM)微調(diào)功能外,研華還提供了帶有生成式AI訓(xùn)練工作室的邊緣AI SDK,預(yù)裝了Llama-2 13B/33B/70B模型,用于聊天機(jī)器人和數(shù)據(jù)分析等應(yīng)用。此舉將簡(jiǎn)化并加速通過(guò)AIR-520進(jìn)行客戶專屬大型語(yǔ)言模型(LLM)模型訓(xùn)練和推理評(píng)估工作的進(jìn)程。此外,研華的DeviceOn提供OTA軟件/容器更新和遠(yuǎn)程管理,促進(jìn)高效的邊緣AI編排和長(zhǎng)期維護(hù)。

產(chǎn)品特性:

● 采用AMD EPYC 7003處理器的服務(wù)器級(jí)性能,提供多達(dá)64個(gè)內(nèi)核、768GB DRAM和四個(gè)PCle x16擴(kuò)展插槽

● 高達(dá)768GB DDR4 3200 DRAM

● 支持4個(gè)PCIe x16擴(kuò)展插槽

● 集成1200W PSU,可為兩塊NVIDIA L40S圖形卡供電

面向生成式AI的AIR-520邊緣AI服務(wù)器方案早期樣品現(xiàn)已推出。

評(píng)論