綜合LSTM、transformer優勢,DeepMind強化學習智能體提高數據效率

來自 DeepMind 的研究者提出了用于強化學習的 CoBERL 智能體,它結合了新的對比損失以及混合 LSTM-transformer 架構,可以提高處理數據效率。實驗表明,CoBERL 在整個 Atari 套件、一組控制任務和具有挑戰性的 3D 環境中可以不斷提高性能。

近些年,多智能體強化學習取得了突破性進展,例如 DeepMind 開發的 AlphaStar 在星際爭霸 II 中擊敗了職業星際玩家,超過了 99.8% 的人類玩家;OpenAI Five 在 DOTA2 中多次擊敗世界冠軍隊伍,是首個在電子競技比賽中擊敗冠軍的人工智能系統。然而,許多強化學習(RL)智能體需要大量的實驗才能解決任務。

最近,DeepMind 的研究者提出了 CoBERL(Contrastive BERT for RL)智能體,它結合了新的對比損失和混合 LSTM-transformer 架構,以提高處理數據效率。CoBERL 使得從更廣泛領域使用像素級信息進行高效、穩健學習成為可能。

具體地,研究者使用雙向掩碼預測,并且結合最近的對比方法泛化,來學習 RL 中 transformer 更好的表征,而這一過程不需要手動進行數據擴充。實驗表明,CoBERL 在整個 Atari 套件、一組控制任務和具有挑戰性的 3D 環境中可以不斷提高性能。

論文地址:https://arxiv.org/pdf/2107.05431.pdf

方法介紹

為了解決深度強化學習中的數據效率問題,研究者對目前的研究提出了兩種修改:

首先提出了一種新的表征學習目標,旨在通過增強掩碼輸入預測中的自注意力一致性來學習更好的表征;

其次提出了一種架構改進,該架構可以結合 LSTM 以及 transformer 的優勢。

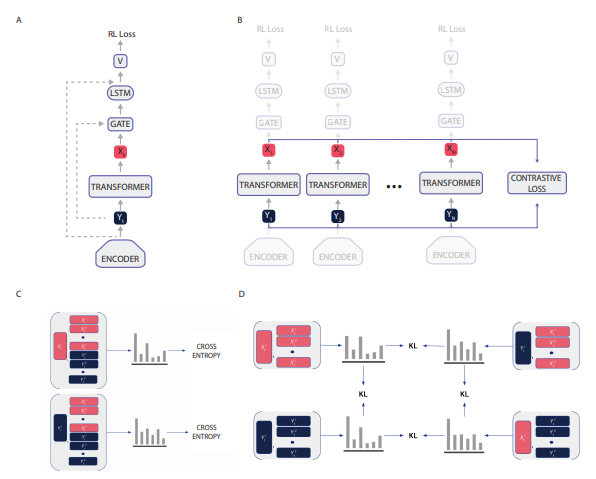

CoBERL 整體架構圖。

表征學習

研究者將 BERT 與對比學習結合起來。基于 BERT 方法,該研究將 transformer 的雙向處理機制與掩碼預測設置相結合。雙向處理機制一方面允許智能體根據時間環境來了解特定狀態的上下文。另一方面,位于掩碼位置處的預測輸入通過降低預測后續時間步長的概率來緩解相關輸入問題。

研究者還使用了對比學習,雖然許多對比損失(例如 SimCLR)依賴于數據擴充來創建可以進行比較的數據分組,但該研究不需要利用這些手工數據擴充來構造代理任務。

相反地,該研究依賴輸入數據的順序性質來創建對比學習所需的相似和不同點的必要分組,不需要僅依賴圖像觀測的數據增強(如裁剪和像素變化)。對于對比損失,研究者使用了 RELIC,該損失同樣適應于時間域;他們通過對齊 GTrXL transformer 輸入和輸出創建數據分組,并且使用 RELIC 作為 KL 正則化改進所用方法的性能,例如 SimCLR 在圖像分類領域以及 Atari 在 RL 領域性能都得到提高。

CoBERL 架構

在自然語言處理和計算機視覺任務當中,transformer 在連接長范圍數據依賴性方面非常有效,但在 RL 設置中,transformer 難以訓練并且容易過擬合。相反,LSTM 在 RL 中已經被證明非常有用。盡管 LSTM 不能很好地捕獲長范圍的依賴關系,但卻可以高效地捕獲短范圍的依賴關系。

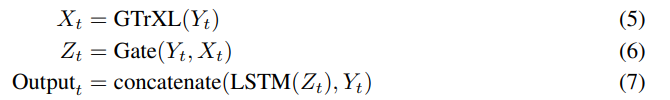

該研究提出了一個簡單但強大的架構改變:在 GTrXL 頂部添加了一個 LSTM 層,同時在 LSTM 和 GTrXL 之間有一個額外的門控殘差連接,由 GTrXL 的輸入進行調制。此外,該架構還有一個包含從 transformer 輸入到 LSTM 輸出的跳躍連接。更具體地說,Y_t 在時間 t 時編碼器網絡的輸出,可以用下列方程定義附加模塊:

這些模塊是互補的,因為 transformer 沒有最近偏差,而 LSTM 的偏差可以表示最近的輸入——等式 6 中的 Gate 允許編碼器表征和 transformer 輸出混合。這種內存架構與 RL 機制的選擇無關,研究者在開啟和關閉策略(on and off-policy)設置中評估了這種架構。對于 on-policy 設置,該研究使用 V-MPO 作為 RL 算法。V-MPO 使用目標分布進行策略更新,并在 KL 約束下將參數部分移向該目標。對于 off-policy 設置,研究者使用 R2D2。

R2D2 智能體:R2D2(Recurrent Replay Distributed DQN) 演示了如何調整 replay 和 RL 學習目標,以適用于具有循環架構的智能體。鑒于其在 Atari-57 和 DMLab-30 上的競爭性能,研究者在 R2D2 的背景下實現了 CoBERL 架構。他們用門控 transformer 和 LSTM 組合有效地替換了 LSTM,并添加了對比表示學習損失。因此,通過 R2D2,以及分布式經驗收集的益處,將循環智能體狀態存儲在 replay buffer 中,并在訓練期間「燒入」(burning in)具有 replay 序列展開網絡的一部分。

V-MPO 智能體:鑒于 V-MPO 在 DMLab-30 上的強大性能,特別是與作為 CoBERL 關鍵組件的 GTrXL 架構相結合,該研究使用 V-MPO 和 DMLab30 來演示 CoBERL 與 on-policy 算法的使用。V-MPO 是一種基于最大后驗概率策略優化(MPO)的 on-policy 自適應算法。為了避免策略梯度方法中經常出現的高方差,V-MPO 使用目標分布進行策略更新,受基于樣本的 KL 約束,計算梯度將參數部分移向目標,這樣也同樣受 KL 約束。與 MPO 不同,V-MPO 使用可學習的狀態 - 價值函數 V(s) 而不是狀態 - 動作價值函數。

實驗細節

研究者證明了 1) CoBERL 在更為廣泛的環境和任務中能夠提高性能,2)最大化性能還需要所有組件。實驗展示了 CoBERL 在 Atari57 、DeepMind Control Suite 和 DMLab-30 中的性能。

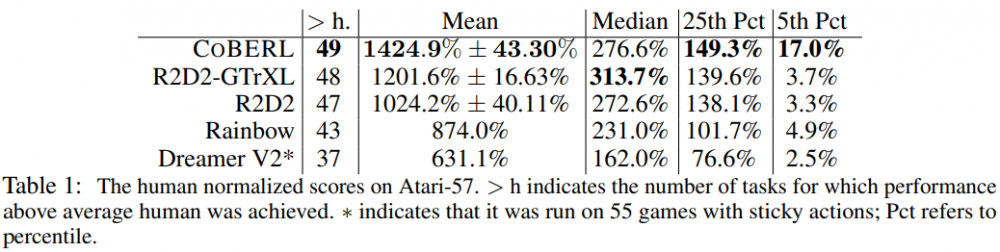

下表 1 為目前可獲得的不同智能體的結果。由結果可得,CoBERL 在大多數游戲中的表現高于人類平均水平,并且顯著高于同類算法平均性能。R2D2-GTrXL 的中值(median)略優于 CoBERL,表明 R2D2-GTrXL 確實是 Atari 上的強大變體。研究者還觀察到在檢查「25th Pct 以及 5th Pct」時 ,CoBERL 的性能和其他算法的差異更大, 這表明 CoBERL 提高了數據效率。

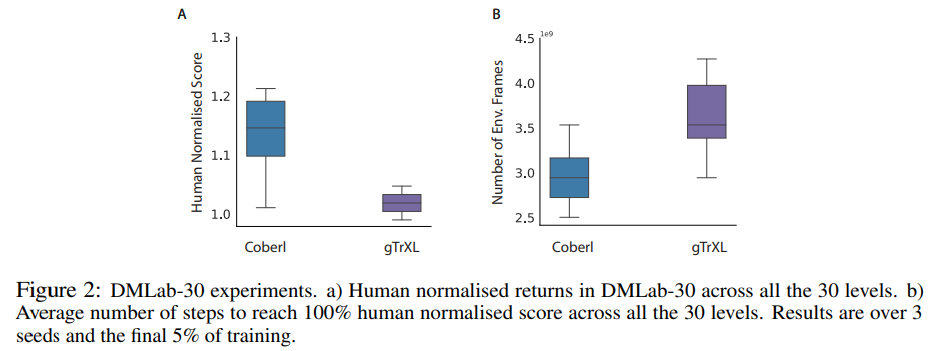

為了在具有挑戰性的 3D 環境中測試 CoBERL,該研究在 DmLab30 中運行,如下圖 2 所示:

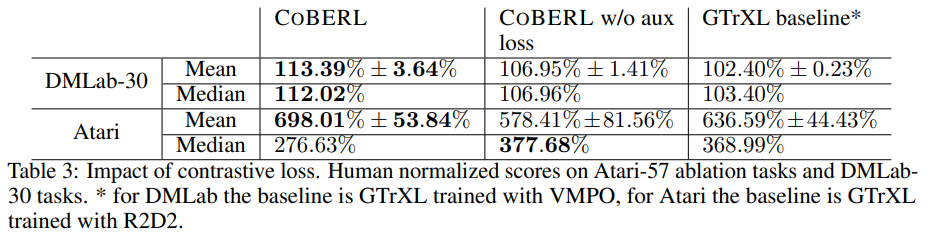

下表 3 的結果表明與沒有對比損失的 CoBERL 相比,對比損失可以顯著提高 Atari 和 DMLab-30 的性能。此外,在 DmLab-30 這樣具有挑戰性的環境中,沒有額外損失的 CoBERL 仍然優于基線方法。

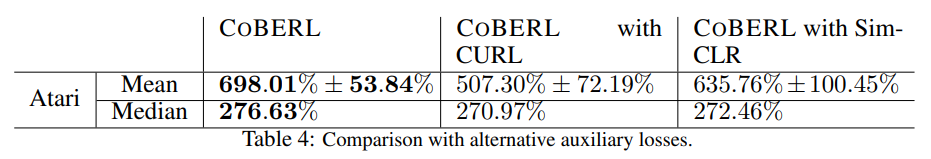

下表 4 為該研究提出的對比損失與 SimCLR、CURL 之間的比較:結果表明該對比損失雖然比 SimCLR、CURL 簡單,但性能更好。

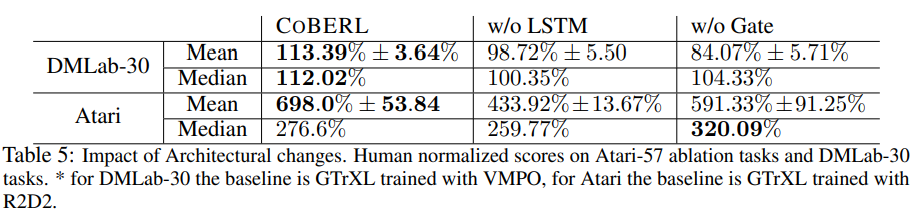

下表 5 為從 CoBERL 中刪除 LSTM 的效果(如 w/o LSTM 一列),以及移除門控及其相關的跳躍連接(如 w/o Gate 一列)。在這兩種情況下 CoBERL 的性能都要差很多,這表明 CoBERL 需要這兩個組件(LSTM 和 Gate)。

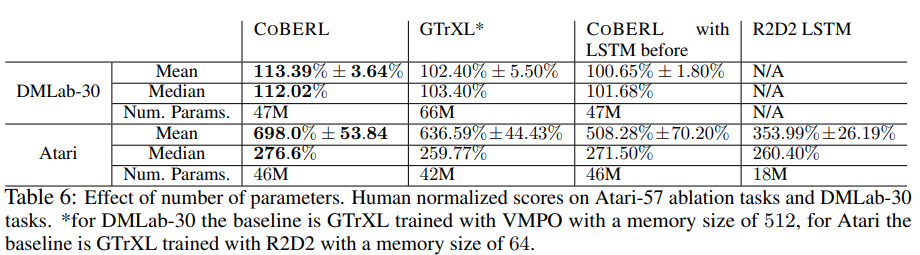

下表 6 根據參數的數量對模型進行了比較。對于 Atari,CoBERL 在 R2D2(GTrXL) 基線上添加的參數數量有限;然而,CoBERL 仍然在性能上產生了顯著的提升。該研究還試圖將 LSTM 移到 transformer 模塊之前,在這種情況下,對比損失表征取自 LSTM 之前。

*博客內容為網友個人發布,僅代表博主個人觀點,如有侵權請聯系工作人員刪除。