AI講座:自編碼器——神奇的ML瑞士刀

1 神奇的自編碼器

在之前各期里,所舉的范例模型都是基于邏輯回歸(Logistic regression)的線性分類器(Linear classifier)。其訓練方法是采取監督式學習(Supervised Learning)模式。在本期里, 將進一步介紹非監督式學習(Unsupervised Learning)模式,并以小而美的自編碼器(Autoencoder,簡稱:AE)為例。自編碼器是一種小而美的ML 模型,它的用途非常多,所以有“ML 瑞士刀”之稱。例如,Pawer Sobel 就稱之為:深度學習瑞士刀。

他在該文章里寫道:“當談到在一個充滿機器學習問題的世界中生存時,有一種演算法可能像瑞士刀一樣通用,它是一種自動編碼器。”

2 復習:分類器(Classifier)

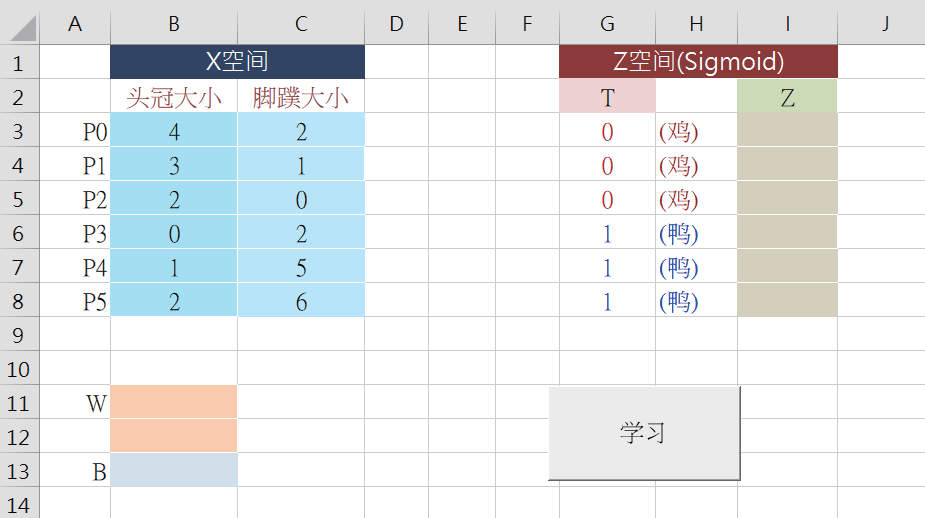

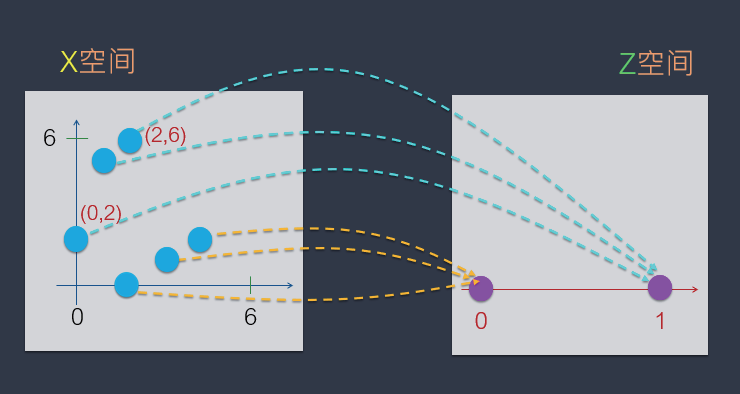

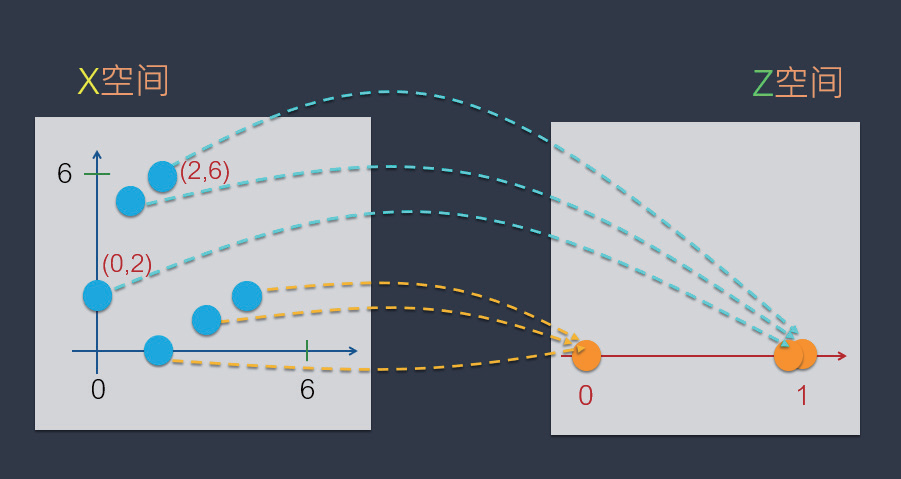

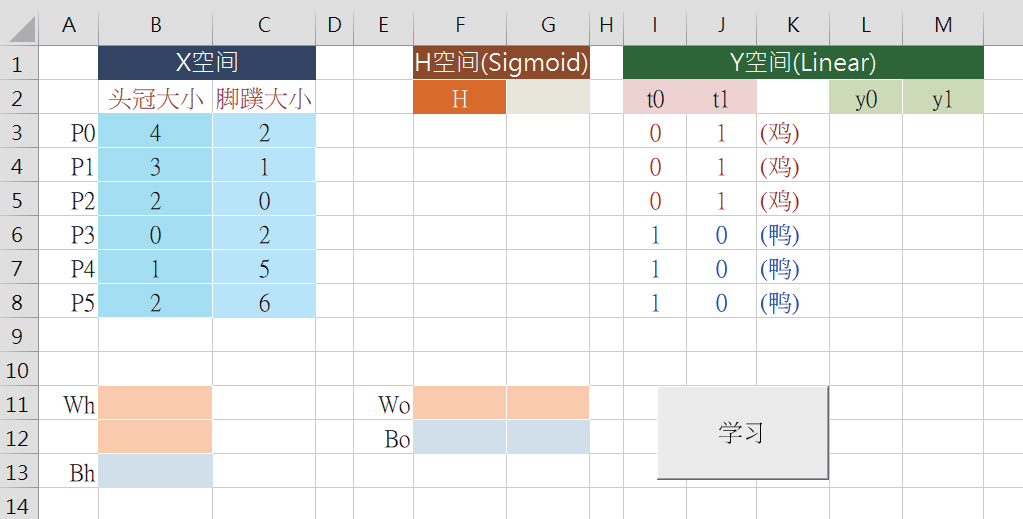

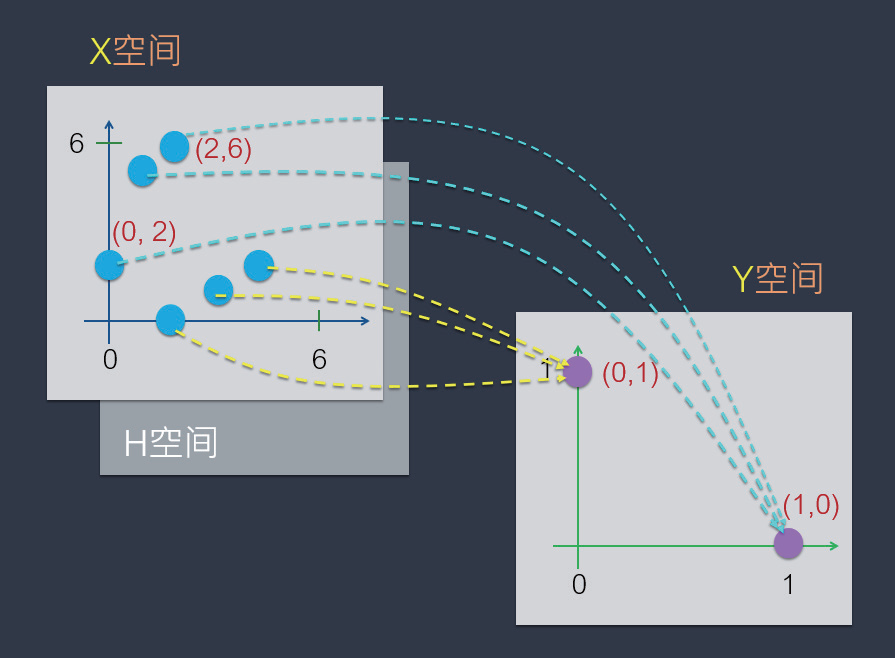

首先來復習您已經熟悉的邏輯回歸(分類器)模型。例如,有一群鴨和雞,我們收集了它們的兩項特征是:頭冠大小與腳蹼大小。如下圖所示:

這是監督式學習模式,我們給予目標值(T),也就是貼上分類標簽(Label)。也就是,在Z 空間里設定了兩個目標值,如下:

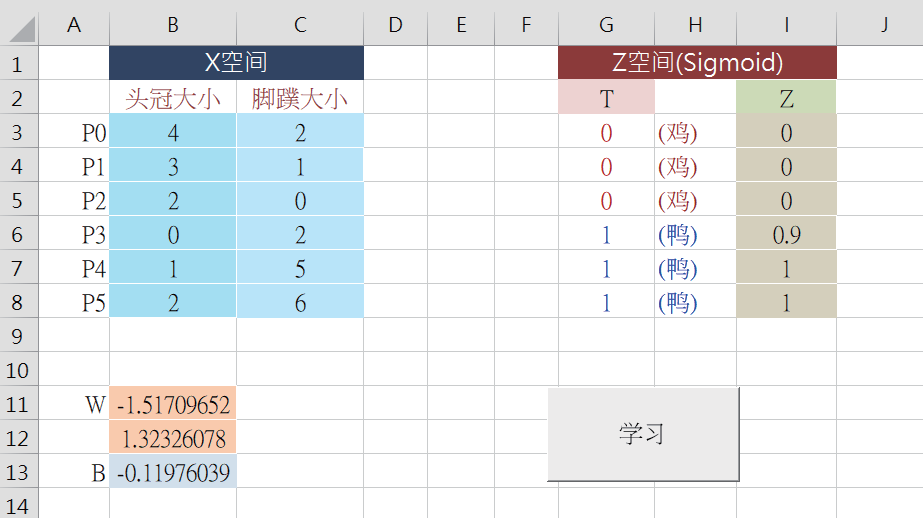

接下來,就可按下“學習”,ML 模型就尋找出最棒的W&B 來表達上述的對應關系。于是,輸出很棒的預測值(Z):

可以看出,已經尋找出很棒的W&B 了,預測值(Z)非常接近于目標值(T)了,呈現出的理想的空間對應關系:

這是一個簡單的分類模型。

3 增添一個新分類器

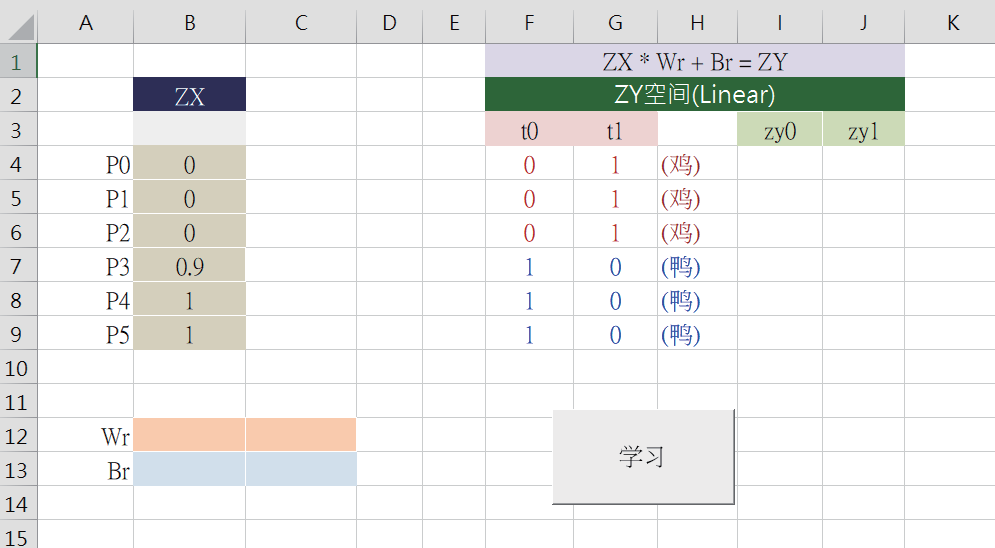

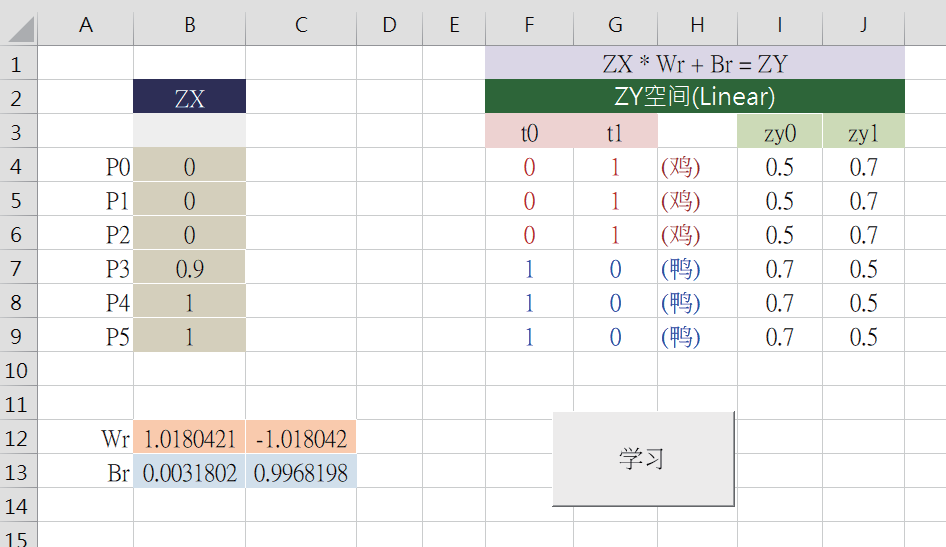

剛才的分類器(取名為分類器-1)已經輸出了預測值(Z)。接下來,我們做一項巧妙的組合:設計一個新的分類器(取名為分類器-2),并且拿這個Z 值做為新模型的輸入值(ZX),如下圖:

這是一個簡單的分類模型,其公式是:ZX * Wr +Br = ZY。接下來,就可按下“學習”,這回歸模型尋找出Wr&Br 得出一條回歸線,并輸出其預測值(Z):

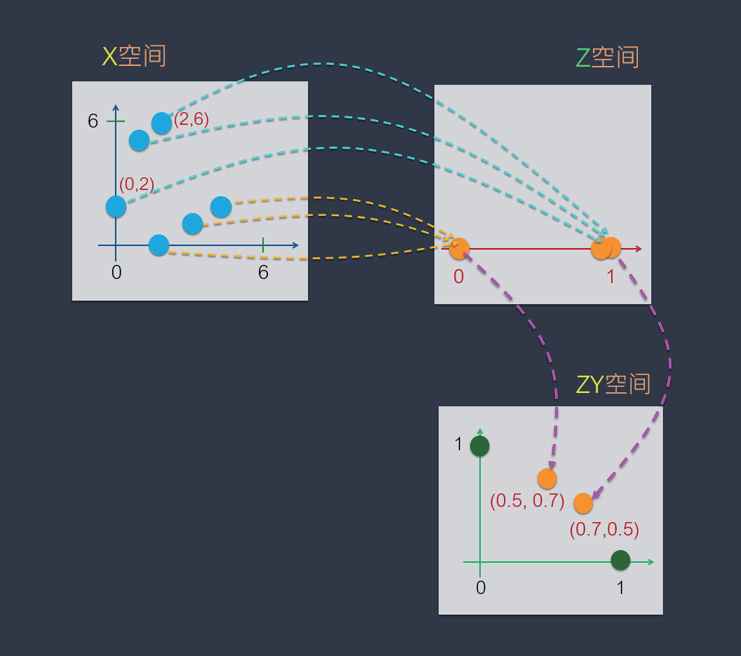

于是,我們共有兩段空間對應關系:1)分類器-1的空間對應;2)分類器-2 的空間對應。現在,將兩者連接起來,形成下述的整合對應關系:

其中,值得留意的是:這兩段的空間對應是獨立訓練(學習)的。然而,現在的ML 是可以多層一起學習的,也就是通稱的深度學習(Deep learning)。

4 組合成為深度學習模型

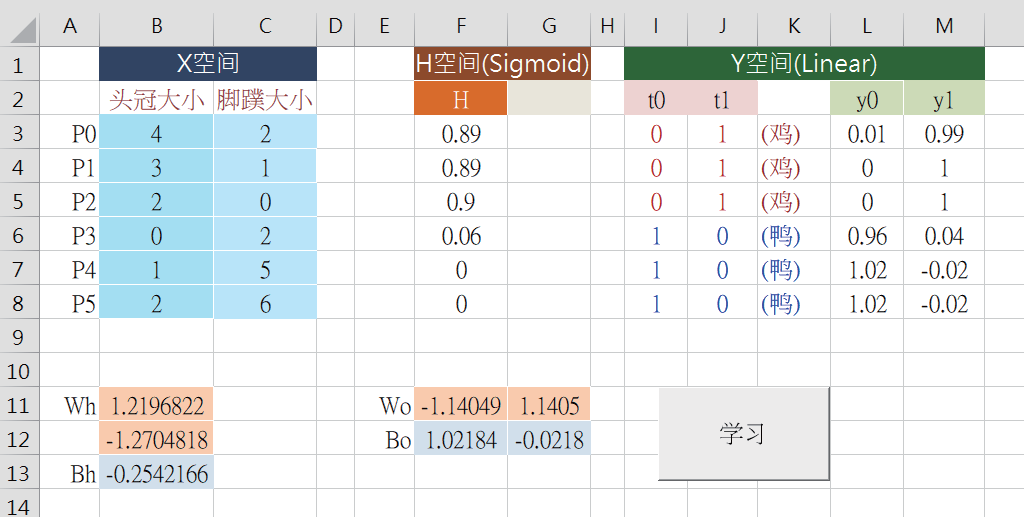

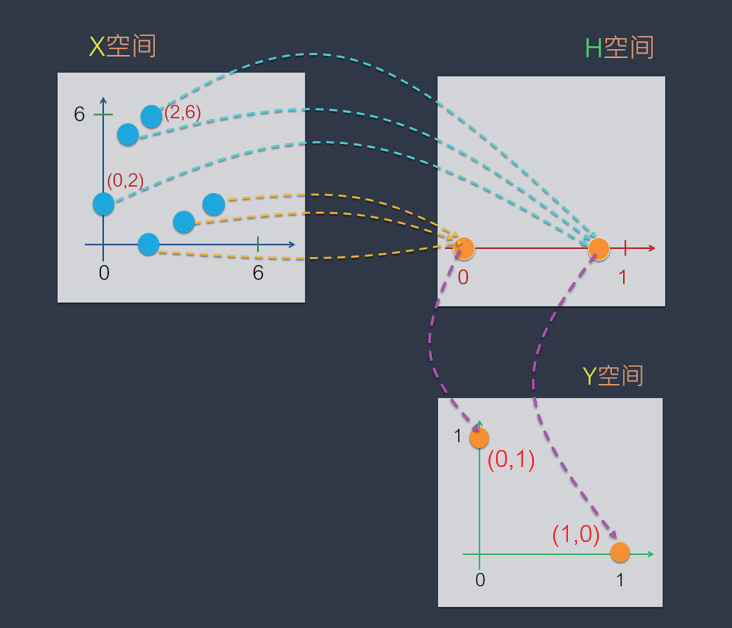

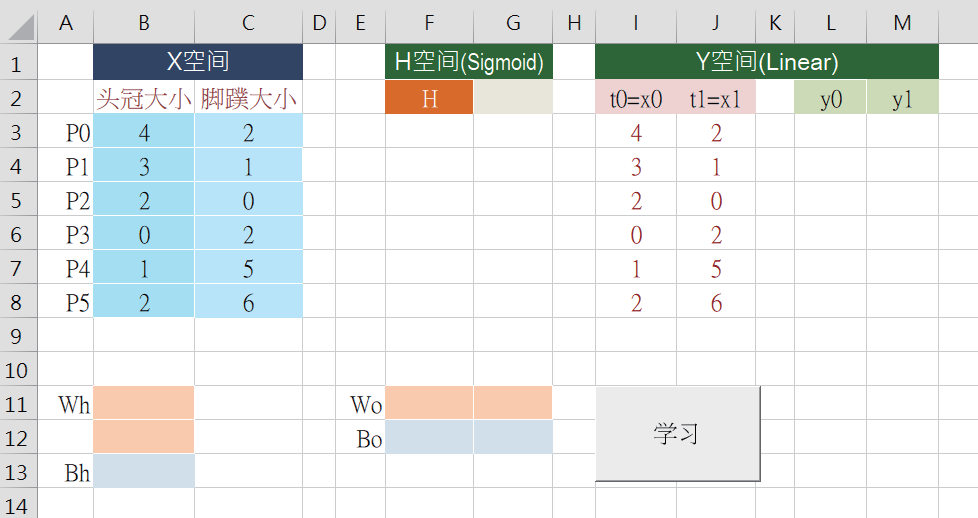

剛才的分類器-1 和分類器-2 都是單層的神經網絡。現在將兩個模型融合為一,成為一個多層的神經網絡。使用Excel 來呈現其數據關聯,如下圖:

此時,中間層通稱為隱藏層(Hidden layer)。上圖里的Wh 和Bh 就是隱藏層的權重和位移;而Wo 和Bo則是輸出層的權重和位移。由于是監督式學習模式,所以在Y 空間里設定了兩個目標值(也就是上圖中的標簽),如下圖所示:

接下來,按下“學習”,這個多層模型就開始學習,尋找出最好的Wh&Bh,以及最好的Wo&Bo,并且,輸出其預測值(Y):

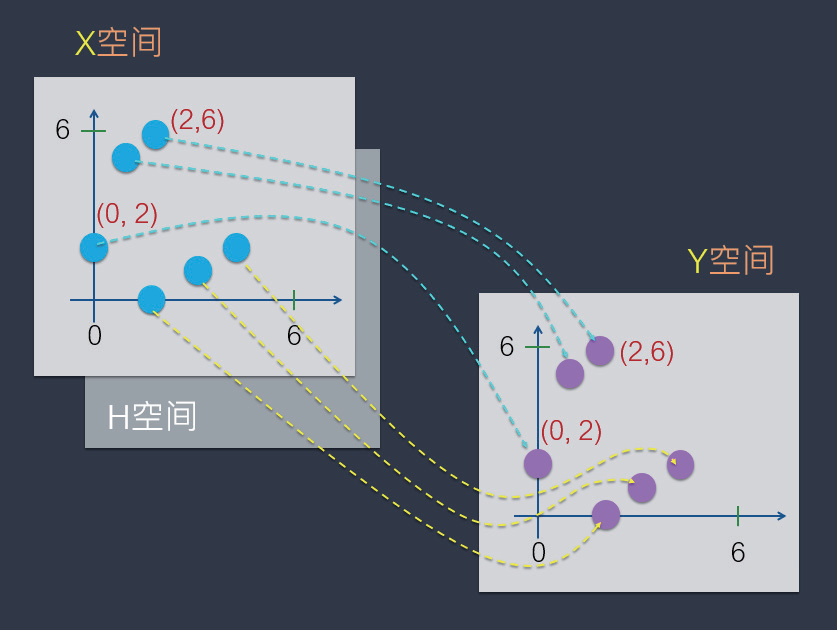

其空間對應關系如下圖所示:

在這個模型里,我們貼上了標簽,所以是監督式學習模式。

5 設計出自編碼器(Autoencoder)

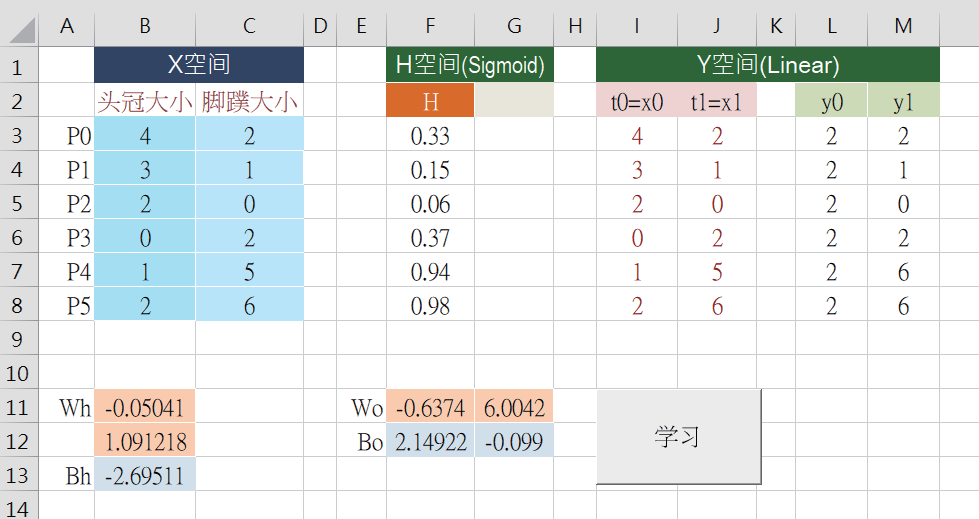

上一小節的多層分類模型,是人為的貼上分類標簽,所以屬于監督式學習。反之,如果不需要人去貼標簽,就稱為非監督式學習了。于是,想一想:如果沒有人去貼標簽,那么這個模型又如何學習呢?于是,ML 專家們就想到一個方法,就是:用輸入值(X)來作為Y 空間的目標值(T),如下圖:

其中,目標值(T)就等于輸入值(X)。由于人們不必去煩惱各筆資料該貼上什么標簽了。因此這個新模型,就屬于非監督式學習了。由于用自己的輸入值當作目標值,所以又稱為自編碼器(Autoencoder)。此時,X 空間與Y 空間的對應關系如下:

接下來,按下“學習”,這個多層模型就開始學習,尋找出最好的Wh&Bh,以及最好的Wo&Bo,并且,輸出其預測值(Y):

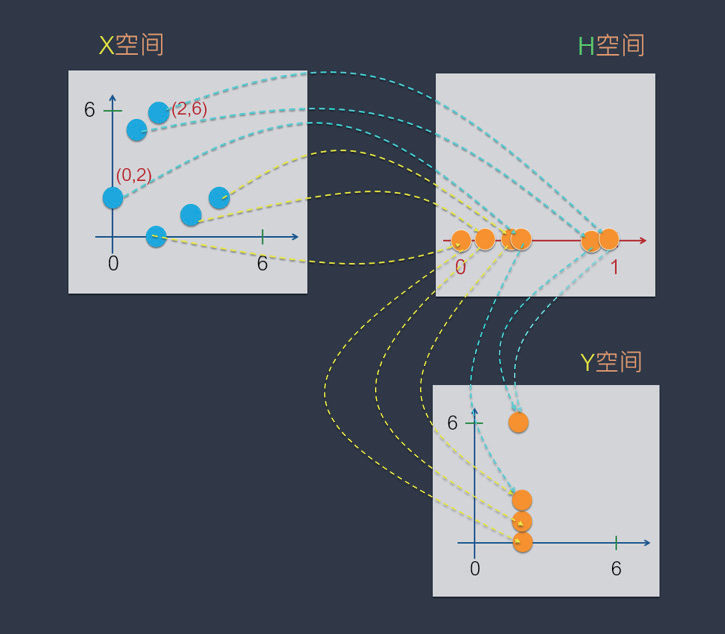

此時的空間對應關系是:

這就是神奇的AE(Autoencoder)模型。它的結構很簡單,而用途卻非常多,所以被稱之為:小而美的神奇ML 瑞士刀。到底他有哪些神奇之處呢?在下一期里,將會為您詳細解說。

(本文來源于《電子產品世界》雜志2021年9月期)

評論