語音識別技術(shù)分析:語音變成文字其實(shí)沒有那么神秘

簡要給大家介紹一下語音怎么變文字的吧。希望這個介紹能讓所有同學(xué)看懂。

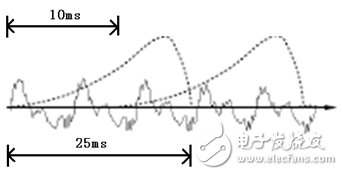

本文引用地址:http://www.104case.com/article/201710/367921.htm首先,我們知道聲音實(shí)際上是一種波。常見的 mp3、wmv 等格式都是壓縮格式,必須轉(zhuǎn)成非壓縮的純波形文件來處理,比如 Windows PCM 文件,也就是俗稱的 wav 文件。wav 文件里存儲的除了一個文件頭以外,就是聲音波形的一個個點(diǎn)了。下圖是一個波形的示例。

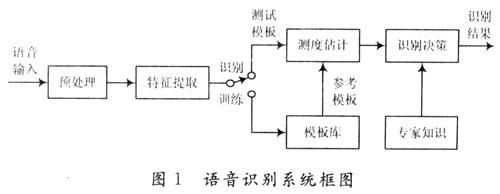

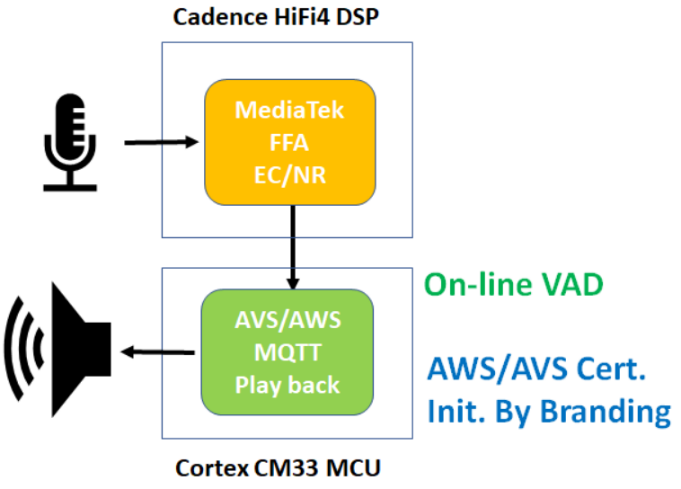

在開始語音識別之前,有時(shí)需要把首尾端的靜音切除,降低對后續(xù)步驟造成的干擾。這個靜音切除的操作一般稱為 VAD,需要用到信號處理的一些技術(shù)。

要對聲音進(jìn)行分析,需要對聲音分幀,也就是把聲音切開成一小段一小段,每小段稱為一幀。分幀操作一般不是簡單的切開,而是使用移動窗函數(shù)來實(shí)現(xiàn),這里不詳述。幀與幀之間一般是有交疊的,就像下圖這樣:

圖中,每幀的長度為 25 毫秒,每兩幀之間有 25-10=15 毫秒的交疊。我們稱為以幀長 25 ms、幀移 10 ms 分幀。圖中,每幀的長度為 25 毫秒,每兩幀之間有 25-10=15 毫秒的交疊。我們稱為以幀長 25 ms、幀移 10 ms 分幀。

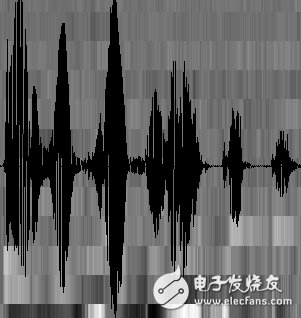

分幀后,語音就變成了很多小段。但波形在時(shí)域上幾乎沒有描述能力,因此必須將波形作變換。常見的一種變換方法是提取 MFCC 特征,根據(jù)人耳的生理特性,把每一幀波形變成一個多維向量,可以簡單地理解為這個向量包含了這幀語音的內(nèi)容信息。這個過程叫做聲學(xué)特征提取。實(shí)際應(yīng)用中,這一步有很多細(xì)節(jié),聲學(xué)特征也不止有 MFCC 這一種,具體這里不講。

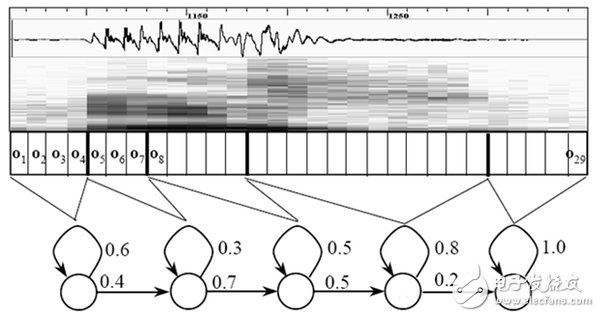

至此,聲音就成了一個 12 行(假設(shè)聲學(xué)特征是 12 維)、N 列的一個矩陣,稱之為觀察序列,這里 N 為總幀數(shù)。觀察序列如下圖所示,圖中,每一幀都用一個 12 維的向量表示,色塊的顏色深淺表示向量值的大小。

接下來就要介紹怎樣把這個矩陣變成文本了。首先要介紹兩個概念:

1.音素:單詞的發(fā)音由音素構(gòu)成。對英語,一種常用的音素集是卡內(nèi)基梅隆大學(xué)的一套由 39 個音素構(gòu)成的音素集,參見 The CMU Pronouncing DicTIonary。漢語一般直接用全部聲母和韻母作為音素集,另外漢語識別還分有調(diào)無調(diào),不詳述。

2.狀態(tài):這里理解成比音素更細(xì)致的語音單位就行啦。通常把一個音素劃分成 3 個狀態(tài)。

語音識別是怎么工作的呢?實(shí)際上一點(diǎn)都不神秘,無非是:

第一步,把幀識別成狀態(tài)(難點(diǎn));

第二步,把狀態(tài)組合成音素;

第三步,把音素組合成單詞。

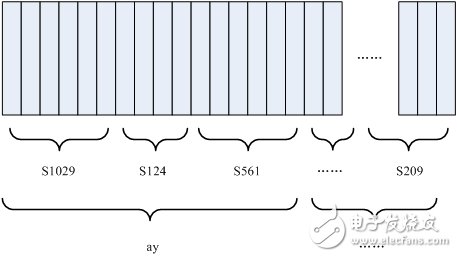

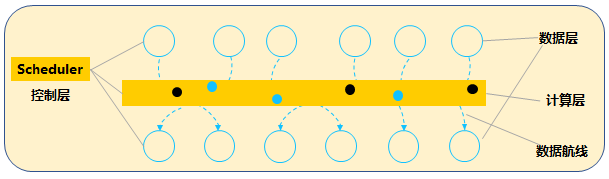

如下圖所示:

圖中,每個小豎條代表一幀,若干幀語音對應(yīng)一個狀態(tài),每三個狀態(tài)組合成一個音素,若干個音素組合成一個單詞。也就是說,只要知道每幀語音對應(yīng)哪個狀態(tài)了,語音識別的結(jié)果也就出來了。圖中,每個小豎條代表一幀,若干幀語音對應(yīng)一個狀態(tài),每三個狀態(tài)組合成一個音素,若干個音素組合成一個單詞。也就是說,只要知道每幀語音對應(yīng)哪個狀態(tài)了,語音識別的結(jié)果也就出來了。

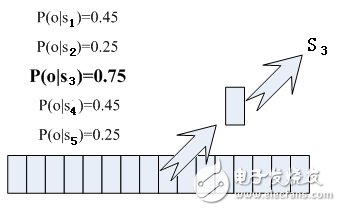

那每幀音素對應(yīng)哪個狀態(tài)呢?有個容易想到的辦法,看某幀對應(yīng)哪個狀態(tài)的概率最大,那這幀就屬于哪個狀態(tài)。比如下面的示意圖,這幀對應(yīng) S3 狀態(tài)的概率最大,因此就讓這幀屬于 S3 狀態(tài)。

那這些用到的概率從哪里讀取呢?有個叫「聲學(xué)模型」的東西,里面存了一大堆參數(shù),通過這些參數(shù),就可以知道幀和狀態(tài)對應(yīng)的概率。獲取這一大堆參數(shù)的方法叫做「訓(xùn)練」,需要使用巨大數(shù)量的語音數(shù)據(jù),訓(xùn)練的方法比較繁瑣,這里不講。

但這樣做有一個問題:每一幀都會得到一個狀態(tài)號,最后整個語音就會得到一堆亂七八糟的狀態(tài)號,相鄰兩幀間的狀態(tài)號基本都不相同。假設(shè)語音有 1000 幀,每幀對應(yīng) 1 個狀態(tài),每 3 個狀態(tài)組合成一個音素,那么大概會組合成300個音素,但這段語音其實(shí)根本沒有這么多音素。如果真這么做,得到的狀態(tài)號可能根本無法組合成音素。實(shí)際上,相鄰幀的狀態(tài)應(yīng)該大多數(shù)都是相同的才合理,因?yàn)槊繋芏獭?/p>

解決這個問題的常用方法就是使用隱馬爾可夫模型(Hidden Markov Model,HMM)。這東西聽起來好像很高深的樣子,實(shí)際上用起來很簡單:

第一步,構(gòu)建一個狀態(tài)網(wǎng)絡(luò)。

第二步,從狀態(tài)網(wǎng)絡(luò)中尋找與聲音最匹配的路徑。

這樣就把結(jié)果限制在預(yù)先設(shè)定的網(wǎng)絡(luò)中,避免了剛才說到的問題,當(dāng)然也帶來一個局限,比如你設(shè)定的網(wǎng)絡(luò)里只包含了「今天晴天」和「今天下雨」兩個句子的狀態(tài)路徑,那么不管說些什么,識別出的結(jié)果必然是這兩個句子中的一句。

那如果想識別任意文本呢?把這個網(wǎng)絡(luò)搭得足夠大,包含任意文本的路徑就可以了。但這個網(wǎng)絡(luò)越大,想要達(dá)到比較好的識別準(zhǔn)確率就越難。所以要根據(jù)實(shí)際任務(wù)的需求,合理選擇網(wǎng)絡(luò)大小和結(jié)構(gòu)。

搭建狀態(tài)網(wǎng)絡(luò),是由單詞級網(wǎng)絡(luò)展開成音素網(wǎng)絡(luò),再展開成狀態(tài)網(wǎng)絡(luò)。語音識別過程其實(shí)就是在狀態(tài)網(wǎng)絡(luò)中搜索一條最佳路徑,語音對應(yīng)這條路徑的概率最大,這稱之為「解碼」。路徑搜索的算法是一種動態(tài)規(guī)劃剪枝的算法,稱之為 Viterbi 算法,用于尋找全局最優(yōu)路徑。

這里所說的累積概率,由三部分構(gòu)成,分別是:

觀察概率:每幀和每個狀態(tài)對應(yīng)的概率

轉(zhuǎn)移概率:每個狀態(tài)轉(zhuǎn)移到自身或轉(zhuǎn)移到下個狀態(tài)的概率

語言概率:根據(jù)語言統(tǒng)計(jì)規(guī)律得到的概率

其中,前兩種概率從聲學(xué)模型中獲取,最后一種概率從語言模型中獲取。語言模型是使用大量的文本訓(xùn)練出來的,可以利用某門語言本身的統(tǒng)計(jì)規(guī)律來幫助提升識別正確率。語言模型很重要,如果不使用語言模型,當(dāng)狀態(tài)網(wǎng)絡(luò)較大時(shí),識別出的結(jié)果基本是一團(tuán)亂麻。

這樣基本上語音識別過程就完成了。

以上介紹的是傳統(tǒng)的基于 HMM 的語音識別。事實(shí)上,HMM 的內(nèi)涵絕不是上面所說的「無非是個狀態(tài)網(wǎng)絡(luò)」那么簡單。以上的文字只是想讓大家容易理解,并不追求嚴(yán)謹(jǐn)。

評論