- 專業 AI 基礎模型開發商 Arena 于今日宣布,將與 AMD 展開合作,擴大 Arena Atlas 在 AMD 的部署。Arena Atlas 是全球首款針對最新工藝節點半導體技術的 AI 測試和優化產品。2023 年期間,AMD 和 Arena 針對 AMD Radeon GPU 測試和優化進行了 Atlas 試點項目。通過快速、自主地識別功耗和性能優化,AMD 工程師可以專注于其他任務,從而提高生產力并加快產品開發速度。Atlas 為半

- 關鍵字:

Arena AMD AI測試 GPU

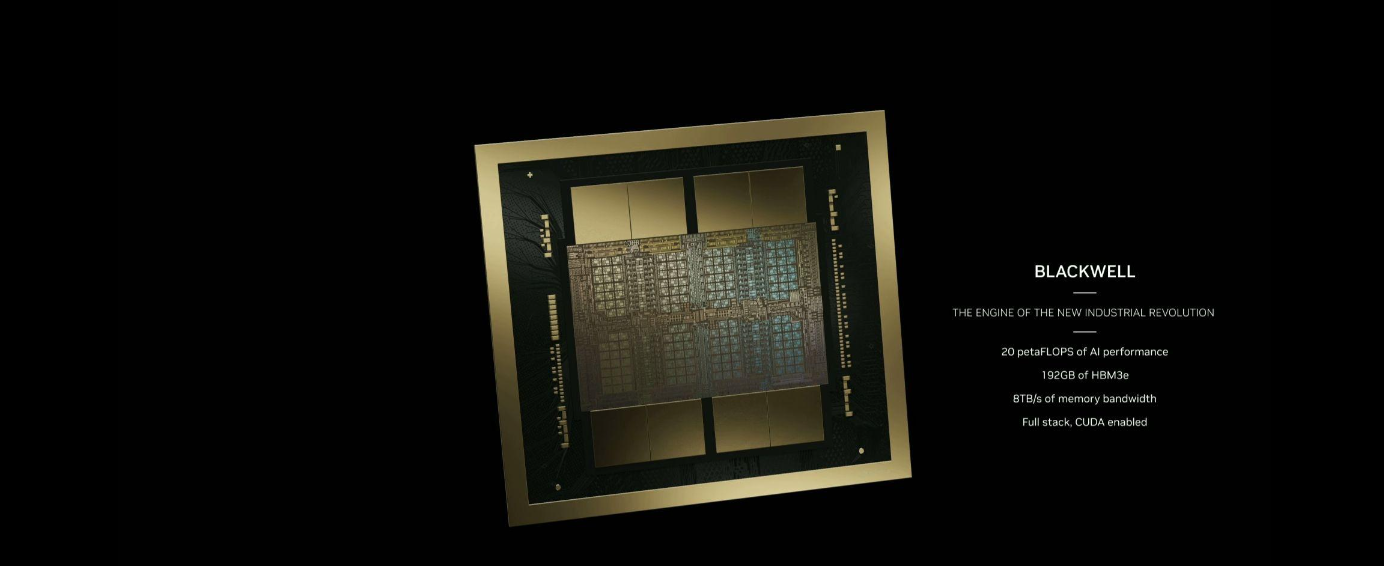

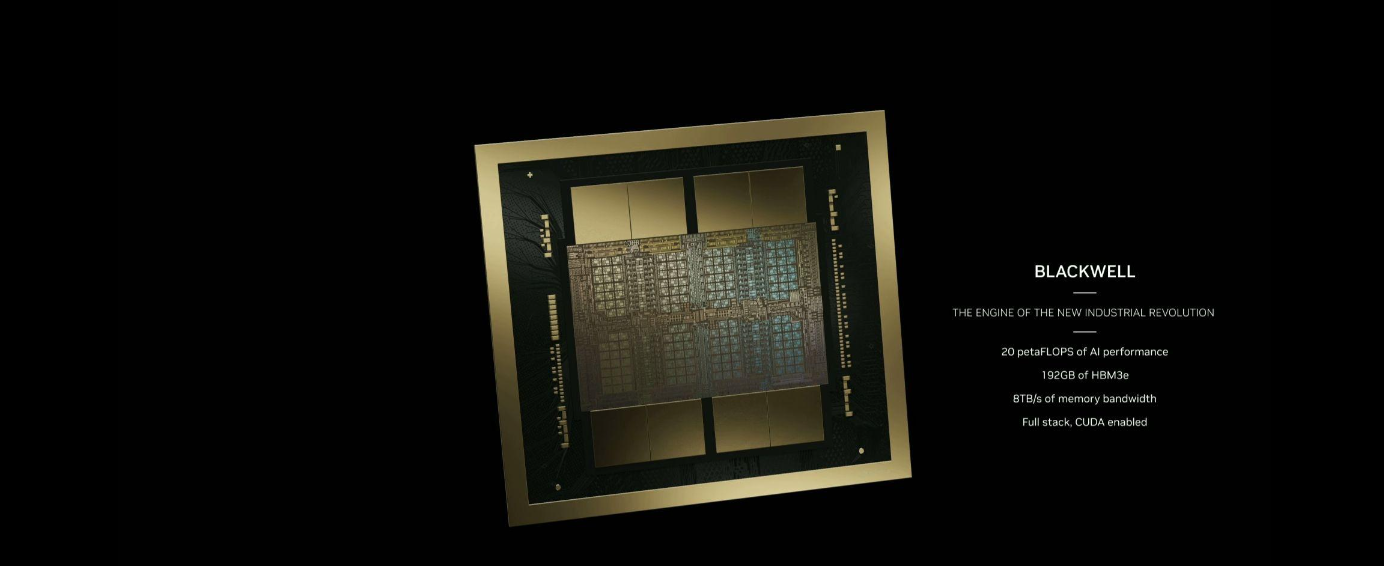

- GTC 2024 大會上,老黃祭出世界最強 GPU——Blackwell B200 ,整整封裝了超 2080 億個晶體管。比起上一代 H100(800 億),B200 晶體管數是其 2 倍多,而且訓 AI 性能直接飆升 5 倍,運行速度提升 30 倍。若是,將千億級別晶體管數擴展到 1 萬億,對 AI 界意味著什么?今天,IEEE 的頭版刊登了臺積電董事長和首席科學家撰寫的文章 ——「我們如何實現 1 萬億個晶體管 GPU」?這篇千字長文,主打就是為了讓 AI 界人們意識到,半導體技術的突破給 AI 技術

- 關鍵字:

GPU 臺積電 英偉達 半導體

- 美國時間18日,人工智能、AI芯片巨頭英偉達的年度開發者大會在加利福尼亞州圣何塞會議中心拉開帷幕。會上,英偉達推出了新一代AI芯片,獲得市場廣泛關注。有投資人在會前稱之為是“AI屆的達沃斯年會”,英偉達的CEO黃仁勛當天推出了新一代GPU芯片“Blackwell”,以及運行AI模型的新軟件“NIM”。ChatGPT問世以來,Nvidia的營業收入不斷攀升,現在已經是當時的兩倍左右。AI軟件的蓬勃發展會繼續激發市場對AI芯片的需求。并且自今年年初以來,NVIDIA的股價已經上漲了80%以上,使得今年的GTC

- 關鍵字:

英偉達 Nvidia GPU

- 正在舉行的美國加利福尼亞州圣何塞舉辦的GTC大會,是全球最具影響力的高性能計算盛會,每年的GTC無數相關高性能計算從業者和數碼愛好者都會期待作為行業龍頭的NVIDIA有會給行業帶來什么驚奇。由于人們對NVIDIA公司以人工智能為動力的增長前景持樂觀態度,自今年年初以來,NVIDIA的股價已經上漲了80%以上,使得今年的GTC大會,尤其讓人關注。今年的GTC大會,NVIDIA能否再續傳奇呢?本篇文章就帶大家來梳理一下。首先,最令人矚目的,便是NVIDIA宣布推出全新平臺——Blackwell,該平臺標志著計

- 關鍵字:

GTC大會 英偉達 GPU AI

- 隨著人工智能革命席卷而來,抓住生成式AI機會的英偉達全面出擊,為大小挑戰者設下新標桿。3月19日,英偉達在2024年GTC大會上發布Hopper架構芯片的繼任者 ——?全新Blackwell架構芯片平臺,包括AWS、微軟和谷歌在內的公司計劃將其用于生成人工智能和其他現代計算任務。

- 關鍵字:

英偉達 Blackwell 芯片 GPU AI

- IT之家 3 月 20 日消息,當地時間 3 月 19 日上午,英偉達 CEO 黃仁勛接受全球媒體采訪。他對記者表示,全球數據中心市場是英偉達的市場機會所在,同時,他對 AI 芯片定價也做出了回應,表示“只是試圖讓大家對定價有一定的感受,而并不是具體的報價”。IT之家將采訪重點內容整理如下:針對有此前英偉達最新一代 AI 芯片 Blackwell 的定價在 3 萬至 4 萬美元的問題,黃仁勛予以回應,他表示:“我只是試圖讓大家對我們產品的定價有一定的感受,而并不打算給出具體的報價。因為根據每一個

- 關鍵字:

英偉達 GPU 計算平臺 AI

- GPU大廠英偉達19日清晨在美國加州圣荷西召開的GTC2024,發表號稱迄今最強AI芯片GB200,今年稍晚出貨。GB200采新Blackwell架構GPU,英偉達創辦人暨執行長黃仁勛表示,兩年前Hopper架構GPU已非常出色,但現在需要更強大的GPU。英偉達每兩年更新頻率,升級一次GPU架構,大幅提升AI芯片性能。英偉達2022年發表Hopper架構H100AI芯片后,引領全球AI市場風潮。如今再推采Blackwell架構的AI芯片性能更強大,更擅長處理AI任務,Blackwell架構是以數學家Dav

- 關鍵字:

臺積電 GPU 英偉達

- ●? ?全新Blackwell GPU、NVLink和可靠性技術賦能萬億參數規模的AI模型●? ?全新Tensor Core與TensorRT-LLM編譯器將LLM推理運行成本和能耗降低多達25倍●? ?全新加速器助推數據處理、工程模擬、電子設計自動化、計算機輔助藥物設計和量子計算領域實現突破●? ?各大云提供商、服務器制造商和頭部AI企業紛紛采用NVIDIA于近日宣布推出NVIDIA Blackwell平臺以賦能計算新時代。

- 關鍵字:

NVIDIA Blackwell GPU

- 3 月 18 日消息,英偉達將在明日舉行GTC 2024 主題演講,黃仁勛預計將宣布名為 Blackwell 的下一代 GPU 架構。據 XpeaGPU 爆料稱,明天推出的 B100 GPU 將采用兩個基于臺積電 CoWoS-L 封裝技術的芯片。CoWoS(晶圓基片芯片)是一項先進的 2.5D 封裝技術,涉及將芯片堆疊在一起,提高處理能力,同時節省空間并降低功耗。XpeaGPU

透露,B100 GPU 的兩個計算芯片將連接到 8 個 8-Hi HBM3e 顯存堆棧,總容量為 192GB。值得注意的是,

- 關鍵字:

英偉達 Blackwell B100 GPU 顯存 CoWoS

- 芯原股份(芯原)近日宣布嘉楠科技(嘉楠)全球首款支持RISC-V Vector 1.0標準的商用量產端側AIoT芯片K230集成了芯原的圖像信號處理器(ISP)IP ISP8000、畸變矯正(DeWarp)處理器IP DW200,以及2.5D圖形處理器(GPU)IP GCNanoV。該合作極大地優化了高精度、低延遲的端側AIoT解決方案,可廣泛適用于各類智能產品及場景,如邊緣側大模型多模態接入終端、3D結構光深度感知模組、交互型機器人、開源硬件,以及智能制造、智能家居和智能教育相關硬件設備等。芯原的ISP

- 關鍵字:

嘉楠 RISC-V AIoT SoC 芯原 ISP IP GPU IP

- IT之家?3 月 6 日消息,固態技術協會?JEDEC 今日正式發布?JESD239 GDDR7 顯存標準(Graphics Double Data Rate),JESD239 GDDR7 提供的帶寬是 GDDR6 的兩倍,每臺設備最高可達 192 GB/s。據介紹,JESD239 GDDR7 是第一個使用脈幅調制(Pulse Amplitude Modulation,PAM)接口進行高頻操作的 JEDEC 標準 DRAM。其 PAM3 接口提高了高頻操作的信噪比(SNR),

- 關鍵字:

GDDR7 顯存 GPU 英偉達 AMD

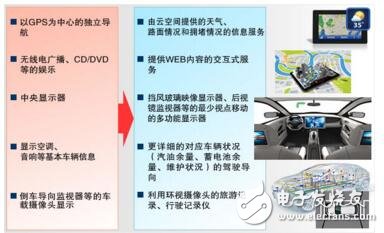

- 2024年3月4日,中國上海——芯原股份(芯原,股票代碼:688521.SH)今日宣布先楫半導體(簡稱“先楫”)的HPM6800系列新一代數字儀表顯示及人機界面系統應用平臺采用了芯原的高性能2.5D圖形處理器(GPU)IP。HPM6800系列產品基于RISC-V CPU內核,具備高算力、低功耗、高集成度和出色的多媒體功能,適用于汽車儀表、人機交互界面(HMI),以及電子后視鏡(CMS)等需要復雜圖形處理、高分辨率顯示和高性能多媒體用戶界面的應用。 芯原支持OpenVG的2.5D GPU IP能夠

- 關鍵字:

芯原 GPU IP 先楫 RISC-V MCU

- 英偉達(NVIDIA)26日宣布,推出全新RTX 500/1000 GPU,以滿足筆電等行動裝置運行AI應用,新筆電預期將在今年春天上市。業者指出,廣達、英業達、仁寶及緯創等可望受惠。英偉達指出,配有全新RTX 500和1000 GPU的Windows筆記本電腦將于今年春季上市,包括戴爾、惠普、聯想和微星都將推出AI NB新品。RTX 500/1000二項新亮相的GPU采用最新Ada Lovelace架構,目前該系列已包含RTX 2000、3000、3500、4000 和5000等多款型號。英偉達指出,全

- 關鍵字:

英偉達 AI筆電 GPU

- IT之家?2 月 27 日消息,據報道,用于人工智能 (AI) 和高性能計算 (HPC) 應用的英偉達 H100 GPU 交貨周期大幅縮短,從之前的 8-11 個月縮減至僅 3-4 個月。這導致一些囤貨的公司正在試圖出售其過剩的 H100 80GB 處理器,因為現在從亞馬遜云服務、谷歌云和微軟 Azure 等大型公司租用芯片更加方便。據 The Information 報道稱,由于稀缺性降低以及維護未使用庫存的高昂成本,一些公司正在轉售其 H100 GPU 或減少訂單,這與去年爭相搶購英偉達 H

- 關鍵字:

英偉達 H100 GPU AI

h100 gpu介紹

您好,目前還沒有人創建詞條h100 gpu!

歡迎您創建該詞條,闡述對h100 gpu的理解,并與今后在此搜索h100 gpu的朋友們分享。

創建詞條

關于我們 -

廣告服務 -

企業會員服務 -

網站地圖 -

聯系我們 -

征稿 -

友情鏈接 -

手機EEPW

Copyright ?2000-2015 ELECTRONIC ENGINEERING & PRODUCT WORLD. All rights reserved.

《電子產品世界》雜志社 版權所有 北京東曉國際技術信息咨詢有限公司

京ICP備12027778號-2 北京市公安局備案:1101082052 京公網安備11010802012473